ChatGLM2-6B 本地化安装

ChatGLM2-6B

🤗 HF Repo • 🐦 Twitter • 📃 [GLM@ACL 22] [GitHub] • 📃 [GLM-130B@ICLR 23] [GitHub]

Read this in English

介绍

ChatGLM2-6B 是开源中英双语对话模型 ChatGLM-6B 的第二代版本,在保留了初代模型对话流畅、部署门槛较低等众多优秀特性的基础之上,ChatGLM2-6B 引入了如下新特性:

- 更强大的性能:基于 ChatGLM 初代模型的开发经验,我们全面升级了 ChatGLM2-6B 的基座模型。ChatGLM2-6B 使用了 GLM 的混合目标函数,经过了 1.4T 中英标识符的预训练与人类偏好对齐训练,评测结果显示,相比于初代模型,ChatGLM2-6B 在 MMLU(+23%)、CEval(+33%)、GSM8K(+571%) 、BBH(+60%)等数据集上的性能取得了大幅度的提升,在同尺寸开源模型中具有较强的竞争力。

- 更长的上下文:基于 FlashAttention 技术,我们将基座模型的上下文长度(Context Length)由 ChatGLM-6B 的 2K 扩展到了 32K,并在对话阶段使用 8K 的上下文长度训练。对于更长的上下文,我们发布了 ChatGLM2-6B-32K 模型。LongBench 的测评结果表明,在等量级的开源模型中,ChatGLM2-6B-32K 有着较为明显的竞争优势。

- 更高效的推理:基于 Multi-Query Attention 技术,ChatGLM2-6B 有更高效的推理速度和更低的显存占用:在官方的模型实现下,推理速度相比初代提升了 42%,INT4 量化下,6G 显存支持的对话长度由 1K 提升到了 8K。

ChatGLM2-6B 开源模型旨在与开源社区一起推动大模型技术发展,恳请开发者和大家遵守开源协议,勿将开源模型和代码及基于开源项目产生的衍生物用于任何可能给国家和社会带来危害的用途以及用于任何未经过安全评估和备案的服务。目前,本项目团队未基于 ChatGLM2-6B 开发任何应用,包括网页端、安卓、苹果 iOS 及 Windows App 等应用。

尽管模型在训练的各个阶段都尽力确保数据的合规性和准确性,但由于 ChatGLM2-6B 模型规模较小,且模型受概率随机性因素影响,无法保证输出内容的准确性,且模型易被误导。本项目不承担开源模型和代码导致的数据安全、舆情风险或发生任何模型被误导、滥用、传播、不当利用而产生的风险和责任。

部署

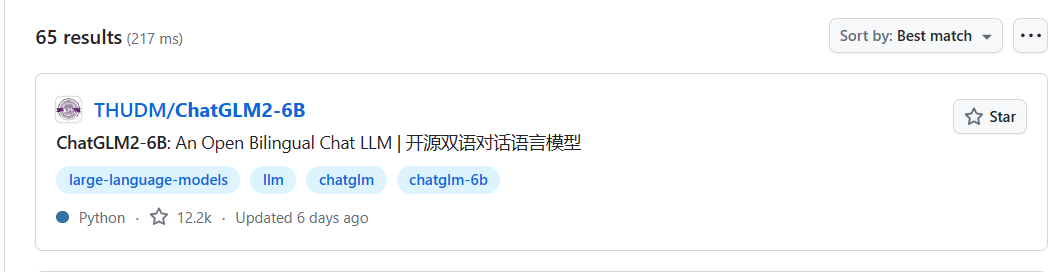

首先我们在GitHub上面搜索【ChatGLM2-6B】

-

选中第一个

-

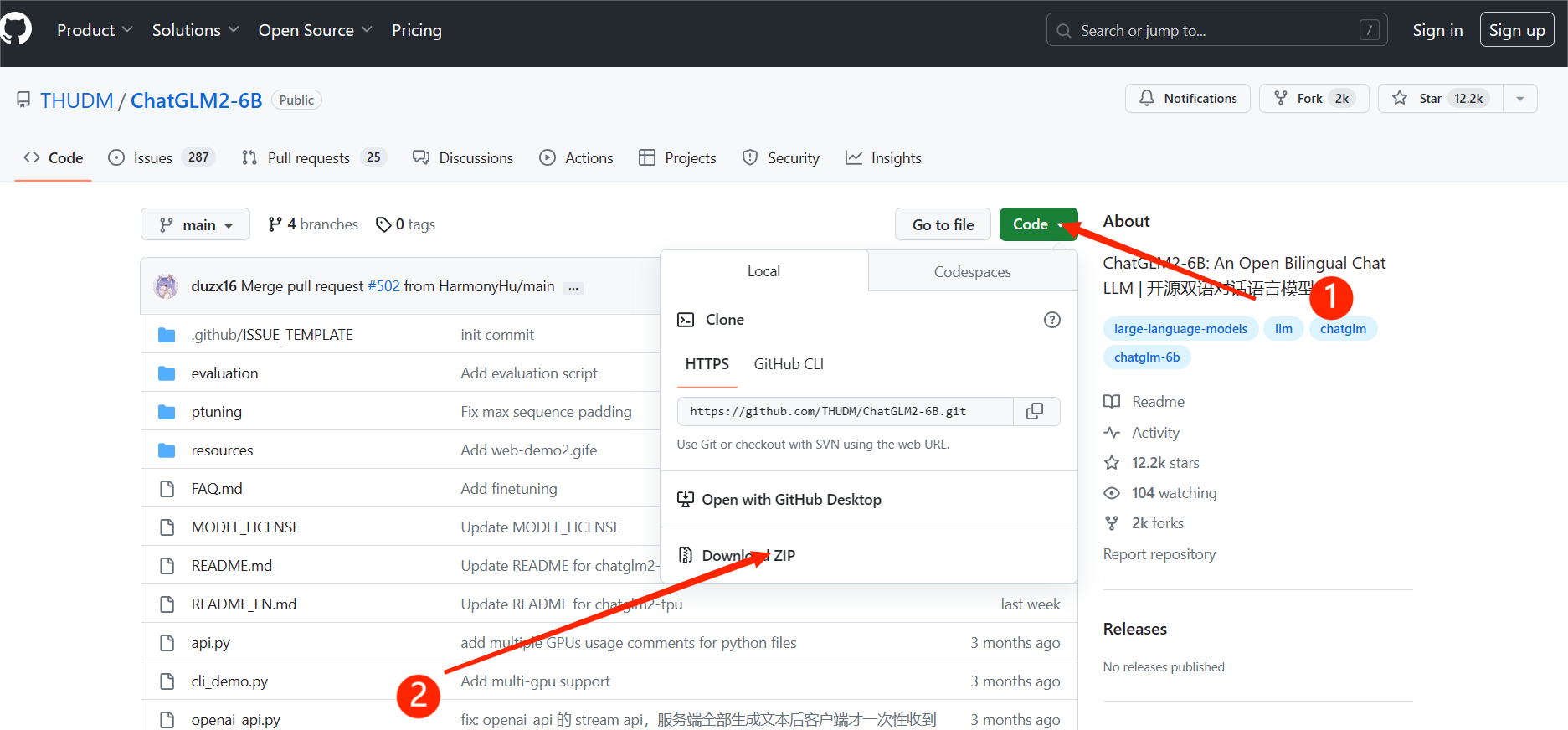

点击Code,然后下载到本地

-

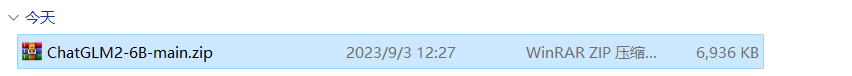

这个样子

-

然后找一个大一点的磁盘解压出来至少要30G,因为后面要下载很多包。

-

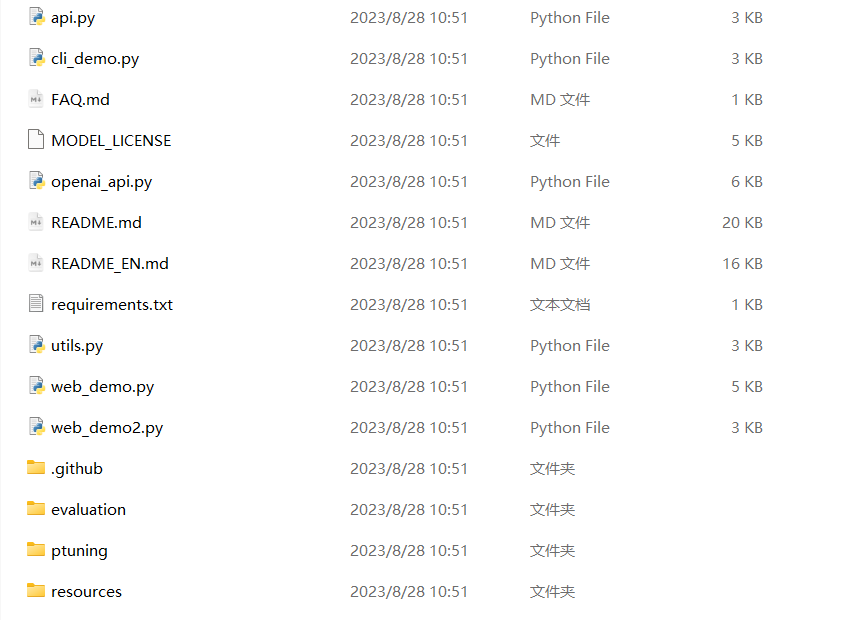

解压出来是这样

准备Python的运行环境

-

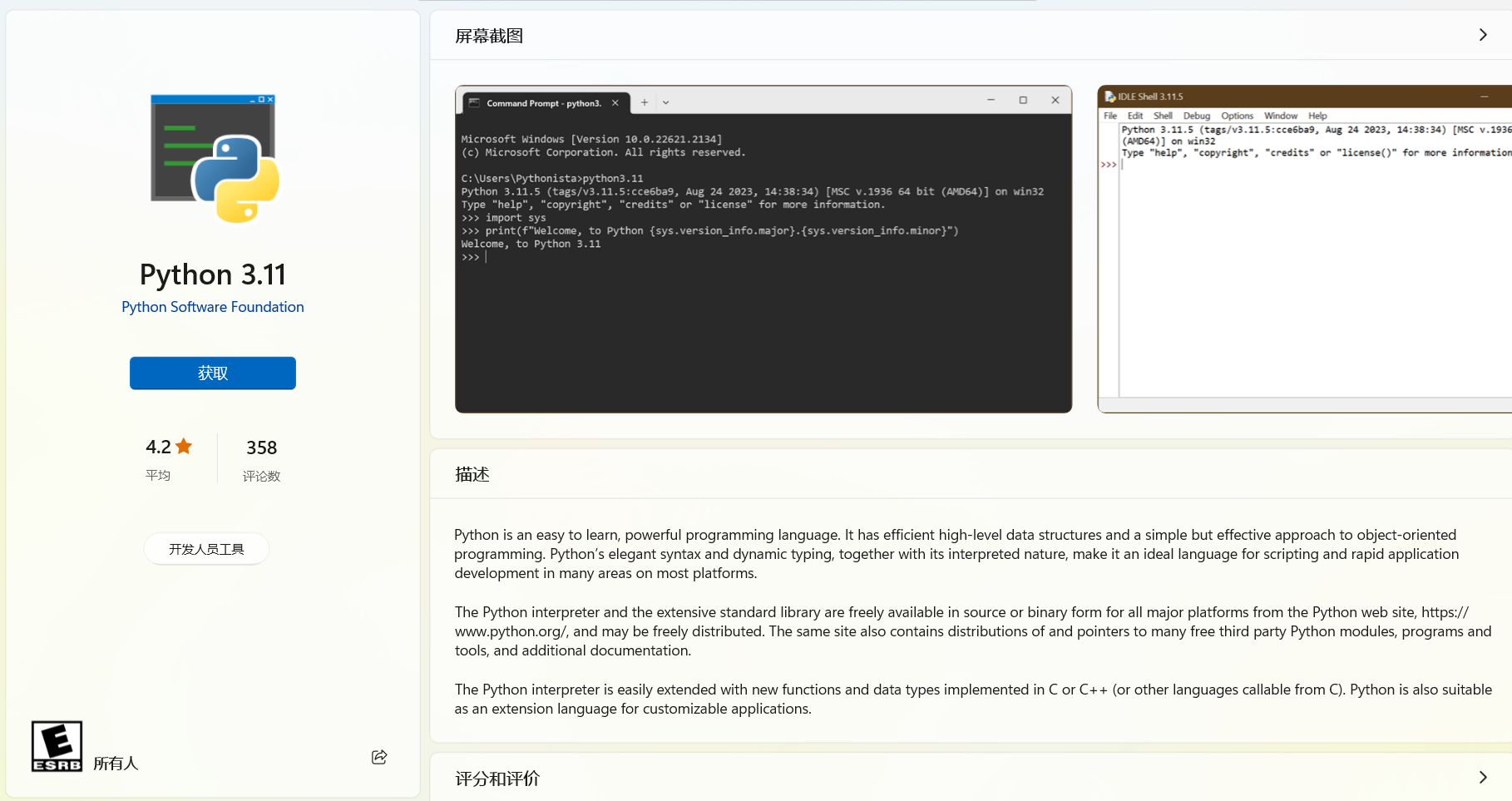

Python我们可以直接在微软应用商店进行下载

-

我这里下载的是3.11,推荐下载3.10及以上,不然容易出现各种问题。

-

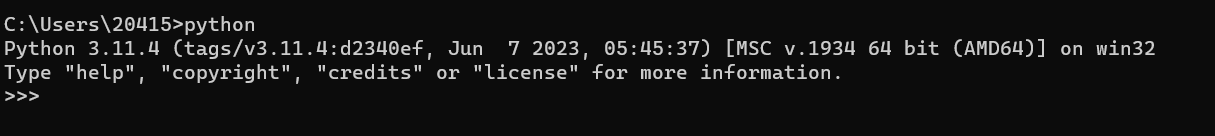

下载完成之后,我们测试一下

win + R

输入 cmd > 回车

python > 回车

-

看到这个界面我们的Python环境就准备好了。

-

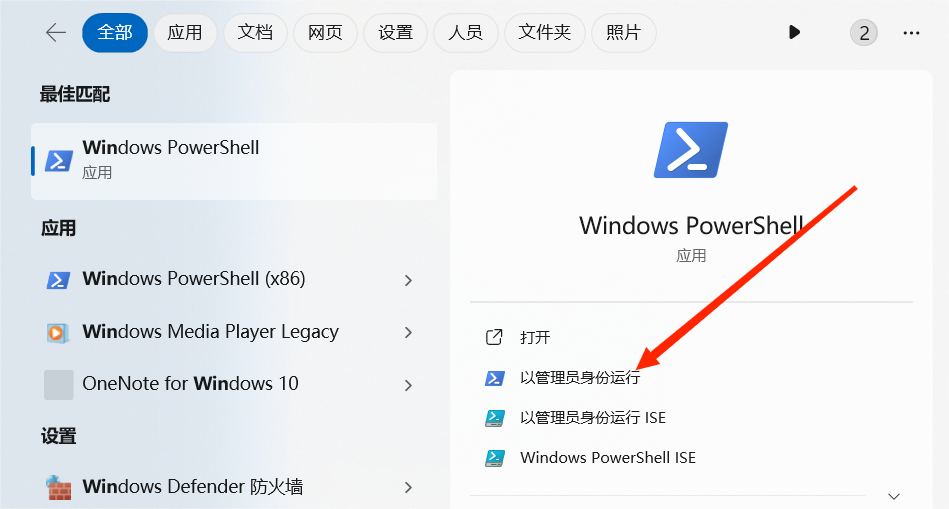

在搜索栏,找到这个,以管理员身份运行

-

输入以下指令:

PS C:\WINDOWS\system32> cd F:\ChatGLM2-6B-main # 这里填写自己解压的路径

# 创建虚拟环境并激活

PS F:\ChatGLM2-6B-main> python -m venv env

PS F:\ChatGLM2-6B-main> .\env\Scripts\activate

# 然后执行 【pip install -r .\requirements.txt】来安装ChatGLM2-6B所需的依赖

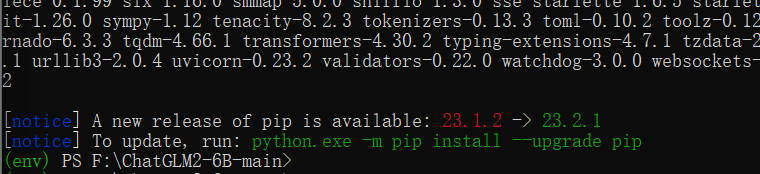

(env) PS F:\ChatGLM2-6B-main> pip install -r .\requirements.txt

到这里就是OK的

到这里就是OK的

- 下面就开始启动ChatGLM2-6B的项目了

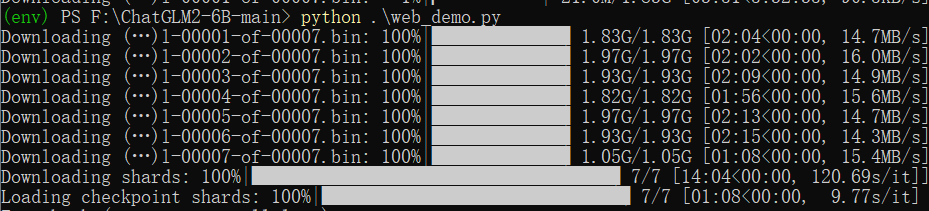

(env) PS F:\ChatGLM2-6B-main> python .\web_demo.py

# 这里大概要下载12G的文件,网络一定要好,不然就。。。

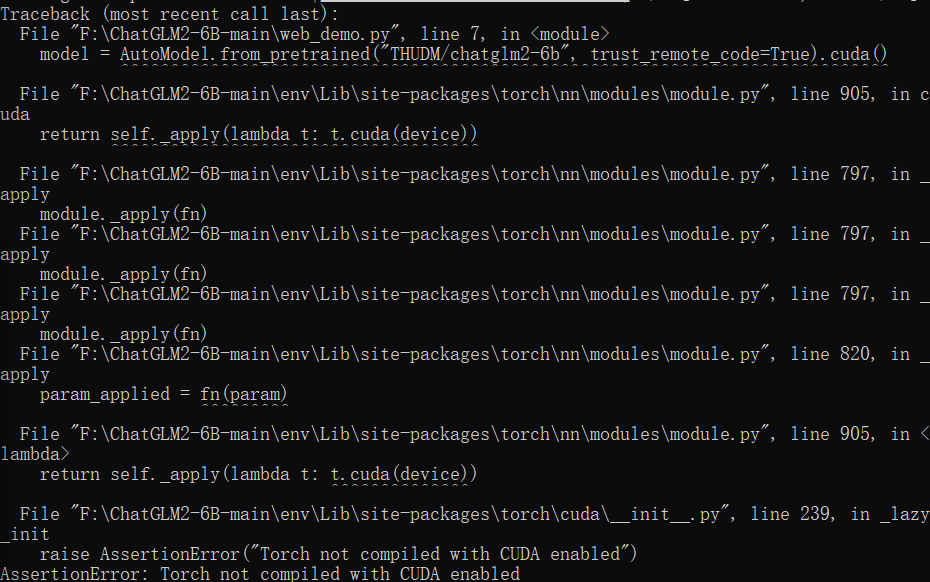

- 到这里 大概率就会出现了如下报错

- 原因就是这个【Torch not compiled with CUDA enabled】,使用的touch版本是CPU版本而不是GPU版本,当然解决办法放下边。

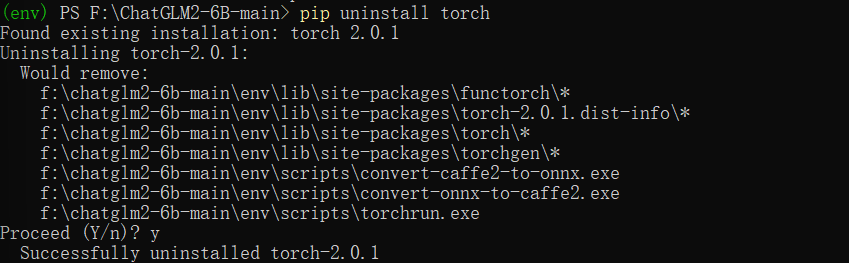

# 执行这条命令,把旧版本的touch删除掉。

(env) PS F:\ChatGLM2-6B-main> pip uninstall torch

# 出现这个确认是否删除,直接【y】回车

Proceed (Y/n)? y

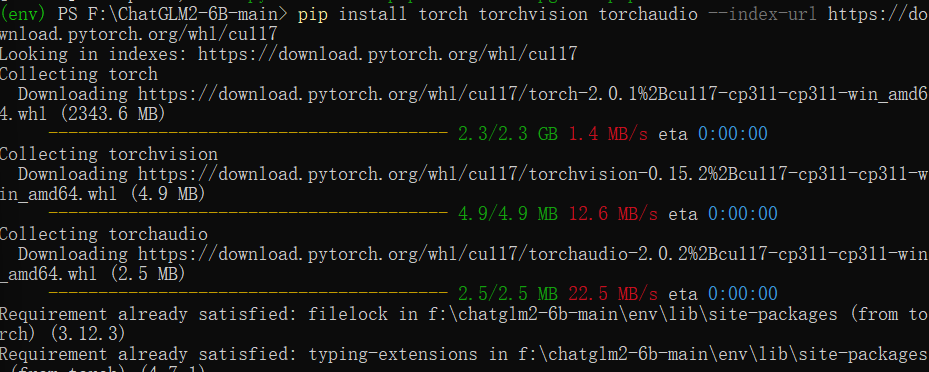

- 然后我们执行下面这条指令,来安装GPU版本的touch

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu117

# 这里会下载一个 2G 的文件

-

看到这个就是下载好了

-

然后再次执行【 python .\web_demo.py 】

(env) PS F:\ChatGLM2-6B-main> python .\web_demo.py

# 这一步会重新加载模型

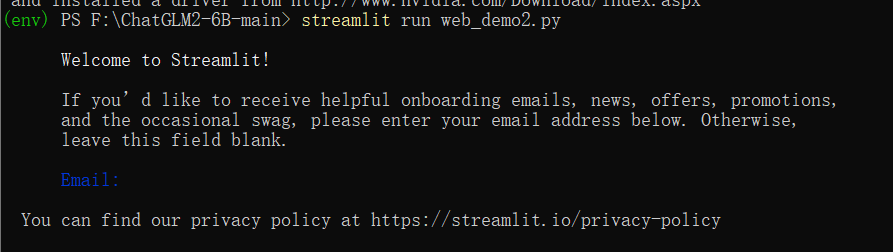

- 然后我们执行这条命令【 streamlit run web_demo2.py 】

(env) PS F:\ChatGLM2-6B-main> streamlit run web_demo2.py

Email: 【直接回车】

# 邮箱这里可以默认不填,直接回车

- 到这一步,如果一切正常的话,那么恭喜你,他就会自动打开你的浏览器,然后你就可以和 ChatGLM2-6B 进行对话了

- 到这里整个【ChatGLM2-6B 本地化安装】就结束啦!

- 如果喜欢的话欢迎 收藏+点赞+留言,博主会不定期更新更多好玩有意思的项目!

- 感谢你赐予我前进的力量